Si alguna vez te has preguntado cómo los modelos de machine learning pueden tomar decisiones complejas basándose en grandes cantidades de datos, probablemente hayas oído hablar de los bosques aleatorios o «random forests». Este método, ampliamente utilizado tanto en clasificación como en regresión, ha demostrado ser una herramienta poderosa y versátil en el arsenal del análisis de datos.

¿Qué son los Bosques Aleatorios?

Los bosques aleatorios son un conjunto de árboles de decisión. La idea principal detrás de este método es construir múltiples árboles de decisión y combinar sus resultados para mejorar la precisión y reducir el riesgo de sobreajuste. Este enfoque es robusto y eficaz, ya que aprovecha la diversidad de los árboles para ofrecer predicciones más fiables.

Historia y Desarrollo

La técnica de los bosques aleatorios fue desarrollada por Leo Breiman y Adele Cutler, quienes vieron la necesidad de mejorar la precisión de los árboles de decisión individuales. Los árboles de decisión, aunque útiles, a menudo sufren de alta varianza y susceptibilidad al sobreajuste. Al crear un «bosque» de árboles y promediar sus predicciones, Breiman y Cutler lograron superar estas limitaciones, dando lugar a una de las técnicas más populares en el aprendizaje automático hoy en día.

¿Cómo Funcionan los Bosques Aleatorios?

Creación del Bosque

- Bootstrap Aggregating (Bagging): Se generan múltiples subconjuntos de datos a partir del conjunto de datos original utilizando muestreo con reemplazo.

- Construcción de Árboles: Para cada subconjunto, se construye un árbol de decisión de manera independiente.

- Promedio de Resultados: Para regresión, se toma el promedio de las predicciones de todos los árboles. Para clasificación, se toma la mayoría de votos.

Ventajas de los Bosques Aleatorios

- Precisión: Al combinar múltiples árboles, se obtiene una predicción más precisa y robusta.

- Reducción del Sobreajuste: Los errores individuales de los árboles se compensan entre sí, reduciendo la probabilidad de sobreajuste.

- Versatilidad: Los bosques aleatorios pueden manejar grandes cantidades de datos y trabajar con diferentes tipos de variables.

Aplicaciones de los Bosques Aleatorios

Diagnóstico Médico

Los bosques aleatorios se utilizan ampliamente en la medicina para la detección y predicción de enfermedades. Por ejemplo, pueden analizar datos de imágenes médicas para identificar patrones que indiquen la presencia de enfermedades como el cáncer.

Finanzas

En el sector financiero, los bosques aleatorios ayudan a predecir el riesgo crediticio, detectar fraudes y realizar análisis de mercado. La capacidad de manejar grandes volúmenes de datos y variables diversas los convierte en una herramienta invaluable para los analistas financieros.

Marketing

En marketing, los bosques aleatorios se emplean para segmentar clientes, predecir comportamientos de compra y optimizar campañas publicitarias. La técnica permite a las empresas tomar decisiones informadas basadas en análisis detallados de datos de clientes.

Ciencia del Clima

Los bosques aleatorios también se aplican en la ciencia del clima para predecir fenómenos meteorológicos y analizar cambios climáticos. Su capacidad para manejar datos complejos y variables interdependientes es especialmente útil en este campo.

Implementación de Bosques Aleatorios

En Python

La biblioteca Scikit-Learn en Python proporciona una implementación sencilla y eficaz de los bosques aleatorios. Aquí tienes un ejemplo básico:

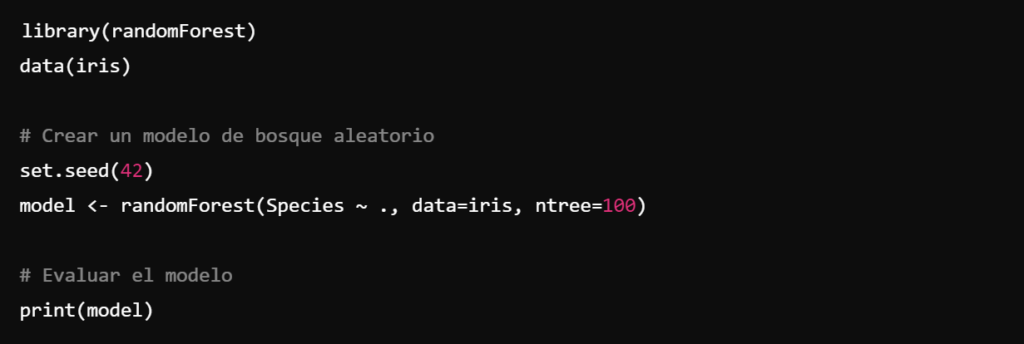

En R

El paquete randomForest en R es otra excelente opción para implementar bosques aleatorios. Aquí tienes un ejemplo básico:

Conclusión

Los bosques aleatorios representan una de las técnicas más potentes y versátiles en el mundo del machine learning. Su capacidad para manejar grandes volúmenes de datos, su robustez ante el sobreajuste y su amplia gama de aplicaciones los hacen indispensables en diversos campos. Ya sea en medicina, finanzas, marketing o ciencia del clima, los bosques aleatorios están transformando la manera en que analizamos y utilizamos los datos.

Deja una respuesta